蔡楚華,蘭誠棟,陳康杰

(福州大學 物理與信息工程學院,福建 福州 350116)

摘要:確定最佳深度可以降低運算成本,同時可以進一步提高精度。針對深度置信網絡深度選擇的問題,文章分析了通過設定閾值方法選擇最佳深度的不足之處。從信息論的角度,驗證了信息熵在每層玻爾茲曼機(RBM)訓練達到穩態之后會達到收斂,以收斂之后的信息熵作為判斷最佳層數的標準。通過手寫數字識別的實驗發現該方法可以作為最佳層數的判斷標準。

關鍵詞:深度置信網絡;信息熵;最佳深度

中圖分類號:TP391文獻標識碼:ADOI: 10.19358/j.issn.1674-7720.2017.09.017

引用格式:蔡楚華,蘭誠棟,陳康杰.深度學習最佳深度的確定[J].微型機與應用,2017,36(9):57-59,66.

0引言

*基金項目: 福建省自然科學基金資助項目(2014J01234);福建省教育廳基金資助項目(JA15061)

人工神經網絡是從信息處理角度對人腦神經元網絡進行抽象,建立某種簡單模型,按不同的連接方式組成不同的網絡[1]。2006年之前,多數的分類、回歸等學習方法通常都只是包含一層隱藏層的淺層學習模型,其局限性在于在有限樣本和計算單元情況下對復雜函數的表示能力有限。在2006年,多倫多大學的Hinton教授提出的深度信念網絡(Deep Belief Network,DBN)[2]的深度學習,使得人工神經網絡又掀起了另一次浪潮。傳統的淺層神經網絡隨機初始化網絡中的權值,容易出現收斂到局部最小值。針對這一問題,Hinton教授提出使用無監督訓練的方法先初始化權值,再通過反向微調權值的方法來確定權值從而達到更好的效果。除此之外,Mikolov[3]提出的基于時間的深度神經網絡(Recurrent Neural Network,RNN)主要用于序列數據的預測,有一定的記憶效應。而之后對于DBN的研究又擴展了一些其他的變種,比如卷積深度置信網絡(Convolutional Deep Belief Networks,CDBN)[4]等。

目前深度學習在語音識別、計算機視覺等領域已經取得了巨大的成功。

但是對于深度學習的研究是近些年才開始的,建模問題是其中的關鍵問題之一,如何針對不同的應用構建合適的深度模型是一個很有挑戰性的問題[5]。DBN目前在應用中依然使用經驗值法來判斷DBN所選用的層數及其節點數,其中文獻[67]研究發現增加DBN的層數到一定的峰值之后,再次增加DBN的層數并不能提升系統性能,反而導致訓練的時間過長,從而增加了計算成本。

近年來針對DBN層數的確定已經有了一些初步的進展,其中高強[8]利用中心極限定理證明了在受限玻爾茲曼機(Restricted Boltzmann Machine,RBM)訓練達到穩態后對應的權值系數矩陣元素服從正態分布,隨著層數的增加,權值系數矩陣越來越趨于正態分布,以權值權重最趨近于正態分布的程度作為確定深度信念網絡層數的依據,通過求出正態分布滿足率來選擇合適的層數。潘廣源等人[9]利用設定重構誤差的閾值來確定層數,在重構誤差未達到這個閾值時則增加一層,雖然重構誤差能夠在一定程度上反映RBM對訓練數據的似然度,不過并不完全可靠[1011]。可以看出現在的方法基本上是設定一個閾值來進行判斷,這樣的做法可能會導致雖然達到了閾值但是效果并不是很好的情況。綜合上述情況,本文提出利用在RBM訓練達到穩態后通過計算隱藏層的信息熵來判斷最佳層數,當增加一層RBM后,信息熵也會增加,當信息熵不再增加時則選取該層作為最佳層數。

1深度信念網絡層數的確定

2006年,Hinton等人提出了深度置信神經網絡,該模型是通過若干個RBM疊加而成[11]。RBM是一個兩層模型,分別為可見層和隱藏層,RBM的訓練方法為首先隨機初始化可見層,然后在可見層和隱藏層之間進行Gibbs采樣,通過可見層用條件概率分布P(h|v)來得到隱藏層,之后同樣利用P(v|h)來計算可見層,重復該過程使得可見層與隱藏層達到平衡,訓練RBM網絡的目標是使得計算后的可見層的分布最大可能地擬合初始可見層的分布。而以訓練數據為初始狀態,根據RBM的分布進行一次Gibbs采樣后所獲得樣本與原數據的差異即為重構誤差[12]。

其中文獻[9]首先引入了RBM的訓練精度隨著深度的增加而提高,并且證明了重構誤差與網絡能量正相關,之后對重構誤差的值設定一個閾值,如果沒有達到該閾值則增加一層;如果達到該閾值則取該層為最佳層數。通過最后的實驗可以發現,雖然選取第4層為最佳層數,但重構誤差在第5層和第6層依然在降低,如果閾值選取得不好,雖然重構誤差能夠滿足閾值的條件,但是選擇的層數得出的結構并不能取得很好的效果。

故本文提出利用穩定后的隱藏層的信息熵來判斷最佳層數。通過信息論可知,信息熵的物理含義表示信源輸出后,信息所提供的平均信息量,以及信源輸出前,信源的平均不確定性,同時信息熵也可以說是系統有序化程度的一個度量,一個系統越是有序,信息熵則越低,反之信息熵越高。而訓練RBM的目標是使得系統的能量函數越小,使系統越有序。所以在RBM訓練完之后,信息熵將會收斂于一個較小值。

假設輸入的矩陣為V=(v1,v2,v3,…,vi),經過RBM訓練之后的輸出矩陣為Y=(y1,y2,y3,…,yj),經過RBM的訓練模型可以通過已知的可視節點得到隱藏節點的值,即:

P(Y)=S(WV+B)(1)

其中W為權重矩陣,B為偏置矩陣,S(x)為激活函數,一般選取Sigmoid函數,即:

![D(S007`3~YX)YS[U1]~{SLS.png D(S007`3~YX)YS[U1]~{SLS.png](http://files.chinaaet.com/images/2017/06/08/6363255675206477752257466.png)

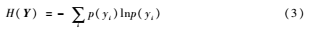

信息熵的求解公式為:

根據Hinton提出的對比散度的算法[13],權重和偏置會根據下式進行更新:

wi,j=wi,j+[P(hi=1|V(0))v(0)j-P(hi=1|V(k))v(k)j](4)

bi=bi+[P(hi=1|V(0))-P(hi=1|V(k))](5)

當RBM訓練到達終態后,則權值wi,j和偏置bi會逐漸收斂,而v是輸入數據,是確定值,所以在訓練達到終態后,p(yi)也會逐漸收斂,同樣信息熵H(Y)會收斂于一個較小值。

當訓練完一層之后,將隱藏層作為第2層的可見層輸入并開始訓練第2層RBM。根據信息熵的另一個物理含義平均信息量可知,在消除不確定性后,信息熵越大則表示所獲得的信息量越多,則隱藏層對于抽取的特征信息量也越大。所以當信息熵不再增加時,所表示的信息量也不再增大,將每層的RBM看作為一個信源,則最后一層的RBM收斂之后信息熵應該比其他層的大,這樣輸入到有監督學習中的信息量才會最大。所以當信息熵不再增加時,則選擇該層作為最佳層數。

2實驗

本實驗使用MATLAB進行仿真,數據庫利用MNIST手寫數字圖片作為實驗數據庫,該數據庫包含各種手寫數字圖片,同時也包含每一張圖片對應的標簽,以供機器學習進行監督學習的訓練,已有很多不同模式識別技術(如KNN、SVM等)利用該數據庫作為實驗數據庫,故該數據庫是評估新方法的比較理想的方式。本實驗將10 000個樣本用于無監督學習。其中MNIST的圖像為28×28的像素,所以第一層的輸入為784個節點,之后每層神經元為100個節點。

通過MATLAB計算出信息熵,每次更新wi,j和bi后計算一次信息熵,由于有10 000個樣本,而每次輸入的均為100個樣本,分100次進行輸入,每一層的RBM訓練都設定為50次的迭代次數。故需要迭代的次數為5 000次,每更新一次后計算出新的信息熵,第2層的信息熵如圖1所示。可以看到當訓練次數增加時,系統逐漸趨于穩定,信息熵逐漸下降并逐漸趨于收斂。

由于要達到平穩后信息熵最大才能使平均信息量最大,所以選取每層3 000次訓練之后的信息熵,對這些信息熵求平均值,作為該層的信息熵。表1為不同深度的訓練數據。通過表1可以看出,隨著深度的增加,信息熵逐漸增加,在增加到第5層時,信息熵相比于第4層計算的信息熵有所下降,所以選擇第4層作為最佳層數。通過表1可以看出,在第4層時誤差率最低,而正確率最高。所以通過信息熵可以判斷出最佳層數。

3結論

深度學習在各個方面都有著很好的應用前景,但是其中依然有著諸如建模問題等。本文針對深度置信網絡(DBN)深度難以選擇的問題進行分析,并且指出現有的閾值選擇方法有可能在閾值選取不好時選取的層數并不是最佳層數。因此本文提出利用信息熵作為選擇層數的選擇標準,當信息熵沒有明顯增加時則選擇該層作為最佳層數,通過實驗發現可以選取到最佳層數,使得效果最好。本文只是針對深度的選擇問題進行研究,而對于RBM依然有超參數的選擇問題,下一步可以探究其他超參數的選取,從而進一步提高算法的收斂速度。

參考文獻

[1] 韓立群.人工神經網絡[M].北京:北京郵電大學出版社,2006.

[2] HINTON G E, SALAKHUTDINOV R R. Reducing the dimensionality of data with neural networks[J]. Science,2006, 313(5786): 504507.

[3] MIKOLOV T, SUTSKEVER I, CHEN K, et al. Distributed representations of words and phrases and their compositionality[C]. Advances in Neural Information Processing Systems, 2013:31113119.

[4] LEE H,GROSSE R,ANGANATH R,et al.Unsupervised learning of hierarchical representations with convolutional deep belief networks[J].Communications of the ACM,2011,54(10): 95103.

[5] 陳先昌. 基于卷積神經網絡的深度學習算法與應用研究[D]. 杭州:浙江工商大學, 2014.

[6] MOHAMED A R,DAHL G E,INTON G.Acoustic modeling using deep belief networks[J].IEEE Transactions on Audio,Speech and Language Processing,2012,20(1): 1422.

[7] AHL G E, DONG Y,LI D et al.Contextdependent pretrained deep neual networks for largevocabulary speech recognition[J].IEEE Transactions on Audio Speech and Language Processing,2012,20(1):3042.