上周,字節跳動開始自研云端 AI 芯片和 Arm 服務器芯片的消息引人關注。新興科技巨頭,是否已經到了全面自研芯片的時代?背后最主要的原因又是什么?

據外國媒體報道,互聯網科技巨頭亞馬遜正開始探索 RISC-V,以考慮替代 Arm 處理器的方案,因為后者正在被英偉達收購。

此前,亞馬遜已經擁有了自己專屬的 AWS 數據中心芯片、人工智能芯片以及各類移動智能設備上的 Arm 芯片。

像亞馬遜一樣,國內外很多此前只涉及軟件和互聯網的科技巨頭都擁有了自主研發的芯片,并且取得了經市場驗證的良好效果。

谷歌的 TPU 和自身的 TensorFlow、算力平臺共同組成了全世界最好的人工智能技術生態;亞馬遜的 Inferentia 集群比英偉達 T4 降低了 25% 延遲和 30% 成本。

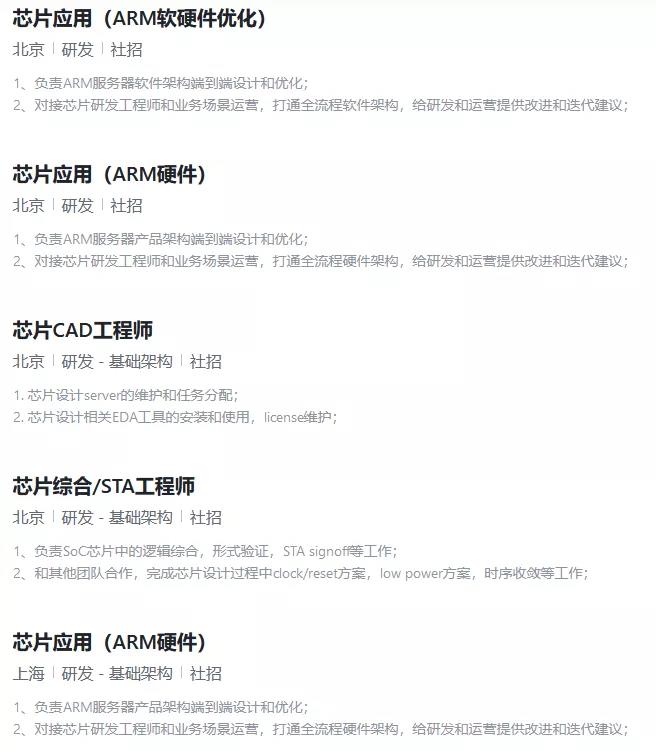

其他互聯網巨頭也正在加速入場,微軟去年12月份表示正在研發Arm芯片;字節跳動近期也開始芯片人才的招聘,探索Arm芯片。字節跳動的相關負責人回應媒體詢問時證實,「是在組建相關團隊,在AI芯片領域做一些探索。」

字節跳動官網上芯片工程師的招聘信息。

在外界看來,互聯網巨頭自研芯片已經成為必然,這勢必會對原本以芯片為主業的半導體巨頭和芯片創業公司產生較大影響。

在這個過程中,需要搞明白一個最核心的問題——互聯網巨頭為什么要自己造芯片,以及在何種情況下才會選擇自研芯片。

業務邊界的持續擴展,數據量的激增,人工智能技術的發展,讓互聯網巨頭對芯片的需求持續增加。

同時,外部的芯片設計工具和 IP 服務也逐漸變強,芯片產業鏈的完善為巨頭自主做芯片提供了成熟的產業基礎。博通每年都會給客戶提供大量定制芯片;蘋果引人關注的 M1 背后,其實也有很多其他公司的身影。這種產業鏈協同和合作幫助互聯網巨頭降低了研發芯片的門檻。

對計算需求的增加和制造門檻的降低只是提供了一個必要背景,在應用層面上,同一個任務會有無數種硬件解決方案,互聯網巨頭們的工作就是選擇哪種硬件方案以及是否需要自己做,自研芯片只是眾多選擇中的一項。他們真正關心的是最具性價比的解決計算任務,而非必須要有自己的芯片。

而決策的唯一依據就是不同方案的成本與收益對比,也就是找到 ROI 最大的方案。

自主研發芯片有著非常高的整體研發成本,包括購買 IP、人員成本、實驗和流片等。互聯網巨頭們大部分的成功經驗都集中在軟件和互聯網領域,他們進入芯片領域也是從零開始,沒有太多可以節省的成本。

灣區一位芯片專家介紹說,谷歌開始做芯片時,從博通挖了很多 ASCI 業務的人,從上到下組建一個全新領域的專業團隊和運營體系,而這種體系與公司此前所擅長的是完全不同的,這又帶來在企業文化和管理上的額外成本和風險。

自主研發芯片的高投入決定了它只適用于可以帶來更高收益的應用場景——芯片能和公司自身業務系統、網絡結構和訓練框架等緊密結合,實現計算成本的顯著下降,產品性能和和用戶體驗的顯著增長。

只有這樣,自研芯片才能獲得最高的 ROI,企業選擇自研方案才有意義。下面以 Arm 芯片、訓練芯片、Codec 和 Smart NIC 等四種芯片為例。

眾所周知,摩爾定律的速度已經開始變緩,數據中心同構體系下基于 x86 的硬件成本沒辦法繼續下降。想要實現計算成本的下降,只能將負載拆分,然后用不同架構和處理器來分別處理,很多負載又是和企業自身網絡結構強相關的,那企業就需要針對這些任務去定制芯片,在這種情況下,企業自主研發 Arm 芯片就是有助于節省成本的。

除了與網絡結構強相關,與訓練框架強相關也會促使公司自主研發芯片。比如有 TensorFlow 的谷歌就一定要去做 TPU,因為谷歌是通過公有云為用戶提供算力租賃和模型訓練服務,而一個模型在其平臺訓練完成所需要的時間和費用是用戶決定是否使用該平臺的最主要因素。谷歌 TPU 與 TensorFlow、云計算的強協同,會帶來遠超通用訓練工具的效果,以及更低的成本。

在去年的 MLPerf 基準測試結果中,谷歌的 TPU 集群打破了 8 項測試紀錄中的 6 項。在 4096 塊 TPU 的加持下,谷歌的超級計算機可以在 33 秒內訓練 ResNet-50、BERT、Transformer、SSD 等模型。在使用 TensorFlow 框架時,BERT 的訓練時間縮短到 23 秒。

在一個圖像分類任務中,用 ImageNet 數據集訓練 ResNet-50 v1.5 達到 75.90% 的準確率,256 個第四代 TPUs 可以在 1.82 分鐘內完成,這幾乎相當于 768 個英偉達 A100 顯卡和 192 個 AMD Epyc 7742 CPU 內核(1.06 分鐘)的速度。

單從芯片架構上來說,TPU 和 GPU 不會產生如此大差異。谷歌 TPU 集群比 A100 快這么多的原因是,用于訓練的芯片與公司自身的網絡結構和訓練框架強相關,TPU 不僅支持自身的網絡結構,還向上支持自己的訓練框架,谷歌知道 TensorFlow 如何去做加速,所以效果肯定會優于通用的 GPU。那最后帶來的結果就是,用戶在谷歌的平臺上獲得了更高性價比的服務,谷歌更好的建立人工智能技術生態。所以,谷歌自主研發 TPU 就是有意義的。

華為也是此類情況,他們擁有升騰 910、MindSpore 和云計算,因此,華為的人工智能技術平臺就擁有了競爭力。徐直軍曾表示,昇騰 910、MindSpore 的推出,標志著華為已完成全棧全場景AI解決方案(Portfolio)的構建,也標志著華為 AI 戰略的執行進入了新的階段。

對于其他類型的定制芯片也是如此,比如 Facebook 做自己的 Codec,這是因為在 Facebook 自身的業務和軟件體系下,上行下行的編解碼處理非常重要。比起使用通用 CPU ,Facebook 選擇自己開發 Codec 就更劃算。

還有智能網卡 Smart NIC,幾乎所有的互聯網巨頭都會自主研發,尤其是提供公有云服務的企業。因為公有云涉及龐大的網絡結構,企業需要去匹配負載和網卡,所以每家企業對 Smart NIC 的需求都是個性化的,不具有通用性,需要定制化,這也是英偉達的 DPU 在市場中表現并不好的原因。

還有一個重要因素是互聯網巨頭都具有規模效應,他們擁有最龐大的機房,為數以千萬計的用戶提供服務,只要性能有微小提升,或者價格有微小下降,就會為用戶帶來巨大價值。

總結來說,對于互聯網巨頭,如果芯片的應用場景和自身業務及軟件強相關,自身對此有個性化需求,最終能通過規模效應最大化收益,那他們就會選擇自主研發。

在其他場景下,當巨頭的芯片需求不是個性化的,所需芯片和自身業務、網絡拓撲結構和軟件體系沒有強相關性,或者說他們需要的是通用芯片時,那巨頭們就無法通過定制來降低成本,也就沒有必要為了一個非定制需求去承擔通用芯片的全部研發成本。

更加合理的方式應該是向其他半導體公司購買,或者戰略投資芯片創業公司進行布局,以與其他客戶或投資機構共同分攤研發成本。x86 CPU 和推理芯片就是屬于這個范疇。

很多公司是沒辦法通過優化自身的拓撲結構和軟件體系來實現 x86 CPU 性價比的大幅提升的,所以最佳選擇就是直接向英特爾購買。

推理芯片也是如此,它在人工智能領域的通用性很強,需要根據算法來進行調整和演進,需要較好的可編程性,那這類芯片就和巨頭自身的網絡拓撲結構和訓練框架并沒有那么直接的關系,大企業也就無法通過深度定制和自主研發大幅降低成本或提升性能,最好的選擇也是購買及投資。

亞馬遜在自主研發與業務相關芯片的同時,也投資了通用人工智能芯片初創公司 Syntiant。字節跳動一方面探索自主研發 Arm 芯片,另一方面,他們投資的一家芯片公司的主要產品也是云端推理芯片。

Syntiant 的深度學習處理器

互聯網巨頭不同的芯片策略和行動為他們實現了最大化收益,同時也使得他們在半導體領域的角色開始變得多樣。

他們是最大的芯片客戶,有著最豐富的計算場景和異常龐大的業務負載,每年為幾家大型半導體公司和新興芯片創業公司帶來海量訂單;同時,他們已經開始定制芯片或自主研發芯片,在某種程度上成為這些半導體大公司和創業公司的潛在競爭對手,或者給他們帶來產品替代風險;最后,他們還是資本巨頭,可以借助資本杠桿,通過投資和并購來完善自己的技術生態。

這些讓互聯網巨頭、半導體巨頭和芯片創業公司之間的關系微妙且復雜,從而也讓市場格局和產業發展趨勢也更加不明確。

但如果我們對以上互聯網巨頭已有策略、行為和結果進行分析,那就很容易發現他們自己在市場中的定位,在一定程度上就可以避免和他們直接競爭,同時還可以圍繞著他們的需求發現更多機會。

比如,根據谷歌的行動,我們就可以判斷訓練芯片可能就更加適合已經有成熟訓練框架和算力的巨頭去做,谷歌已經證明了,通過芯片、訓練框架和算力的強綁定可以獲得比 GPU 更好的效果。

如果創業公司只做一個訓練芯片,沒有自己的訓練框架,也無法與不同客戶的網絡拓撲結構和軟件系統產生強耦合關系,那是很難與英偉達去競爭的,同時也面臨谷歌的競爭。

而以推理芯片為代表的人工智能通用芯片就會存在更大機會,它是獨立的,考慮的是可編程性和靈活性,與客戶的網絡及軟件沒有強相關性。

互聯網巨頭對此沒有定制化開發的需求,反而因為自身的需求及成本收益的考慮,會更傾向于戰略投資這個方向的創業公司,或直接購買這類芯片。

同時,一個領域專用的推理芯片也是可以在性價比方面超過 GPU 的。GPU 的應用領域較廣,包括 Graph、人工智能和高性能計算等,人工智能又包含推理和訓練。GPU 巨頭很難去選一個細分領域,為一個小市場去重新設計一套架構,他們依然是以一個市場領導者的角色去關注最通用、最廣泛的市場。

而創業公司完全可以選擇一個最細分的方向,比如說云端推理芯片,然后專注于架構和性能提升上,且花費更低的成本,從而在這個細分市場上取得成功。